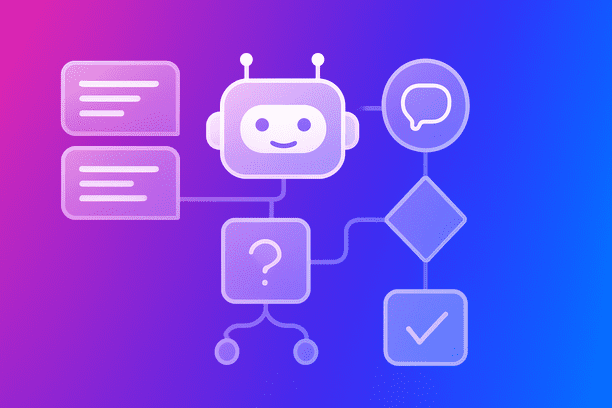

Een AI-chatbot verwerkt elke gebruikersvraag via zes samenhangende technische fasen: intake valideert binnenkomende berichten, NLU ontleedt de tekst tot machine-leesbare betekenis, het taalmodel genereert het antwoord, dialog management bewaart gesprekscontext, API-koppelingen halen actuele bedrijfsdata op, en feedbackloops verbeteren het systeem structureel. Deze bouwstenen werken sequentieel, waarbij elke fase het resultaat van de vorige verwerkt en fouten direct doorwerken in het eindresultaat.

Een marketingmanager die verantwoordelijk is voor leadgeneratie via de website, wordt ook afgerekend op de kwaliteit van die leads. Als een chatbot daarin een rol speelt, maar de manager geen zicht heeft op wat er technisch gebeurt, wordt beoordelen of het systeem goed functioneert vrijwel onmogelijk. De technologie wordt dan een black box: resultaten zijn zichtbaar, maar de oorzaken van fouten of tegenvallende prestaties niet.

Inzicht in de technische werking lost dat probleem op. Wie begrijpt hoe een AI-chatbot een vraag verwerkt, kan realistische eisen stellen, kwaliteitssignalen herkennen en de juiste randvoorwaarden bewaken. Denk aan een makelaar die merkt dat zijn chatbot prijsvragen consequent fout beantwoordt: zonder technisch inzicht lijkt dat een mysterie, mét inzicht is het direct te herleiden naar een specifieke bouwsteen in de verwerkingsketen.

Dit artikel beschrijft uitsluitend de technische werking: van het moment dat een gebruikersbericht binnenkomt tot het moment dat een antwoord verschijnt. Geen commerciële voordelen, geen implementatiestappen, maar de mechanische logica achter elk gesprek. Stap voor stap, bouwsteen voor bouwsteen.

Een AI-chatbot verwerkt elke gebruikersvraag via zes samenhangende fasen, waarbij iedere fase afhankelijk is van het resultaat uit de vorige stap. De keten start met intake: een bericht komt binnen, wordt gevalideerd en akkoord bevonden. Alleen geldige input gaat verder naar de NLU-fase, waar de tekst wordt omgezet naar machine-leesbare betekenis. De kwaliteit van deze omzetting is cruciaal voor de volgende stap: intent- en entiteitherkenning. Die herkende bedoeling en bijbehorende informatie worden vervolgens doorgegeven aan dialog management, dat beslist wat het logische vervolg is op basis van de gesprekscontext.

Hierna volgt de fase waarin het taalmodel het uiteindelijke antwoord genereert of selecteert, waarbij het model afhankelijk is van zowel de juiste intent als aanvullende context, inclusief actuele data uit gekoppelde systemen. Als het antwoord is geformuleerd, wordt dit verstuurd en direct vastgelegd in logboeken. Deze logs vormen later de input voor feedbackloops om het systeem te blijven verbeteren. Problemen of fouten die bij intake, NLU, dialog management of dataverrijking ontstaan, werken door en hebben direct invloed op volgende fasen en het eindresultaat.

Intake is waar een bericht wordt ontvangen, gevalideerd en klaargezet voor verwerking. Verschillende kanalen leveren verschillende soorten data: WhatsApp geeft bijvoorbeeld telefoonnummers en tijdstempels mee, terwijl een webchat context kan bieden zoals de bezochte pagina. Metadata en contextinformatie beïnvloeden de verdere verwerking en beschikbare klanthistorie.

Tijdens intake vindt validatie plaats, zoals taalherkenning en filtering op lege berichten of spam. Dit minimaliseert ruis in de keten en waarborgt dat alleen bruikbare berichten worden verwerkt. Latency start bij intake; technische overhead per kanaal beïnvloedt de totale responstijd. Validatie aan het begin zorgt dat het systeem verderop efficiënter werkt.

Natural Language Understanding is de eerste en misschien wel belangrijkste verwerkingsstap: het systeem moet begrijpen wat de gebruiker bedoelt. NLU start met tokenisatie (opdelen van tekst in eenheden), gevolgd door syntactische en semantische analyse om te bepalen wie/wat/waar in de zin.

De kern van NLU bestaat uit intent-herkenning (wat wil de gebruiker?) en entiteitextractie (welke specifieke data staat erin?). Hoe goed dit werkt hangt af van het gekozen taalmodel, de kwaliteit van trainingsdata en de mate waarin domeinspecifieke taal is verwerkt. Problemen zoals ambiguïteit, jargon en spelfouten beïnvloeden direct het verdere verloop van de conversatie.

Het taalmodel genereert of selecteert het inhoudelijke antwoord op basis van de herkende intent, beschikbare context en – indien nodig – actuele bedrijfsdata. Grote taalmodellen zijn generiek en worden pas bruikbaar voor organisaties via fine-tuning (aanvullende training op bedrijfsspecifieke data) of prompt-injectie (relevante instructies meegeven per chat).

Hallucinatie, waarbij het model overtuigend maar fout antwoordt, blijft een risico en wordt beperkt met technische guardrails zoals instructies, confidence-drempels en fallback-opties. Zo blijft het systeem betrouwbaar in zakelijke toepassingen.

Dialog management zorgt dat de chatbot de context van het gesprek onthoudt en gestructureerd handelt. State tracking slaat relevante informatie over het lopende gesprek op. De policy-engine selecteert de beste vervolgstap, op basis van herkenning of vaste regels (rule-based) of door te leren van eerdere interacties (reinforcement learning).

Valt er geen passend vervolg te bepalen of wordt de vraag te complex, dan schakelt het systeem over naar een menselijke medewerker via een fallback-mechanisme.

Een taalmodel kent geen actuele voorraad, klanthistorie of prijzen. De chatbot schakelt via API’s direct met bedrijfs- of backend-systemen om real-time gegevens op te halen – een proces dat bekendstaat als Retrieval-Augmented Generation (RAG). Bij binnenkomst van een vraag haalt de chatbot de benodigde gegevens op voordat het antwoord wordt geformuleerd.

De prestatie van deze koppeling hangt af van de snelheid en beschikbaarheid van de API’s. Traagheid, uitval, of verouderde en ongestructureerde data kunnen resulteren in incorrecte antwoorden. Beveiliging is essentieel: alleen de juiste data mag worden opgehaald en AVG-normen moeten worden gevolgd.

Verbetering van een AI-chatbot komt pas door gestructureerde feedbackloops. Gespreksdata worden vastgelegd en handmatig beoordeeld op succes of fouten. Die beoordelingen leveren nieuwe trainingsdata om het model bij te sturen en te actualiseren.

Twee structurele risico’s vereisen aandacht: bias in de data (vertekende representatie door scheve samenstelling) en veroudering (nieuwe producten of beleid ontbreken dan). Regelmatige updates en diversiteit in trainingsdata zijn dus noodzakelijk.

Betrouwbaarheid van een AI-chatbot valt te meten op drie centrale punten. Intent-herkennauwkeurigheid meet welk percentage van de binnengekomen vragen juist wordt gecategoriseerd. De meeste systemen werken met confidence-thresholds: een intent moet een minimale zekerheidsscore behalen voor verdere afhandeling. Ontbreekt die, dan vraagt het systeem om verduidelijking of wordt er geëscaleerd.

Latency is de tweede maatstaf: het tijdsverloop tussen vraag en antwoord, bepaald door de snelheid van NLU-verwerking, API-respons en antwoordgeneratie. Een trage chatbot – zelfs als deze accuraat is – frustreert de gebruiker.

Datakwaliteit is de derde factor en beïnvloedt alles. Onvolledige bronnen, wisselende termen en verouderde data werken door tot in elk aspect van de prestaties. Transparante gesprekslogboeken maken het mogelijk eventuele fouten gericht terug te vinden in de procesketen.

Een AI-chatbot bestaat uit samenwerkende bouwstenen: intake, NLU, het taalmodel, dialog management, actuele databronnen en feedbackloops. Elk onderdeel kent eigen eisen en foutbronnen. Het systeem is zo sterk als zijn zwakste schakel.

Duidelijk inzicht in deze bouwstenen helpt je als beslisser om voorwaarden te stellen, prestaties te beoordelen en gerichte vragen te stellen aan je technische partners. De oorzaak van technische problemen is vrijwel altijd te herleiden tot een van deze zes fasen.

Wil je meer weten over AI-chatbots en hun plaats in het klantcontactlandschap? Lees dan het overzichtsartikel over AI-chatbots.

Bconnect adviseert over techniek én praktijk van AI-chatbots, van taalmodelkeuze tot feedbackloops en data-integratie. Verkennen hoe deze bouwstenen in jouw situatie samenkomen? Neem contact op via de button onderaan deze pagina.

Hallucinatie ontstaat wanneer het taalmodel overtuigend maar feitelijk onjuist antwoordt, vaak door gebrek aan actuele of domeinspecifieke kennis. Dit wordt beperkt door technische guardrails zoals confidence-drempels, expliciete instructies (prompt-injectie), fine-tuning op bedrijfsdata en het inzetten van fallback-mechanismen die doorverwijzen naar menselijke medewerkers bij twijfel.

RAG is het proces waarbij de chatbot real-time actuele data ophaalt uit externe systemen via API’s voordat een antwoord wordt gegenereerd. Hierdoor kan het taalmodel, dat zelf geen toegang heeft tot actuele voorraad, prijzen of klanthistorie, toch correcte en actuele informatie verstrekken. De kwaliteit hangt direct af van de snelheid en betrouwbaarheid van deze API-koppelingen.

Chatbot-prestaties worden gemeten op drie punten: intent-herkennauwkeurigheid (percentage correct geïdentificeerde vragen), latency (reactietijd van vraag tot antwoord) en datakwaliteit (volledigheid en actualiteit van bronnen). Confidence-scores bepalen of het systeem zeker genoeg is om te antwoorden of moet escaleren naar een menselijke medewerker.

Als de NLU-fase de intent niet met voldoende zekerheid kan herkennen of als de confidence-score onder de drempelwaarde blijft, activeert het fallback-mechanisme. De chatbot vraagt dan om verduidelijking of schakelt direct door naar een menselijke medewerker. Dialog management bepaalt op basis van de gesprekscontext wat de beste vervolgstap is.